前回までの学習で機械学習の手順の基本について学びました!今回からはアルゴリズムについて学んでいきましょう!

目次

機械学習のアルゴリズムについて

機械学習のアルゴリズムとは、簡単に言うと「問題を解く方法」です。どのような考え方で、予測・分類を行うのか様々な手法が存在します。

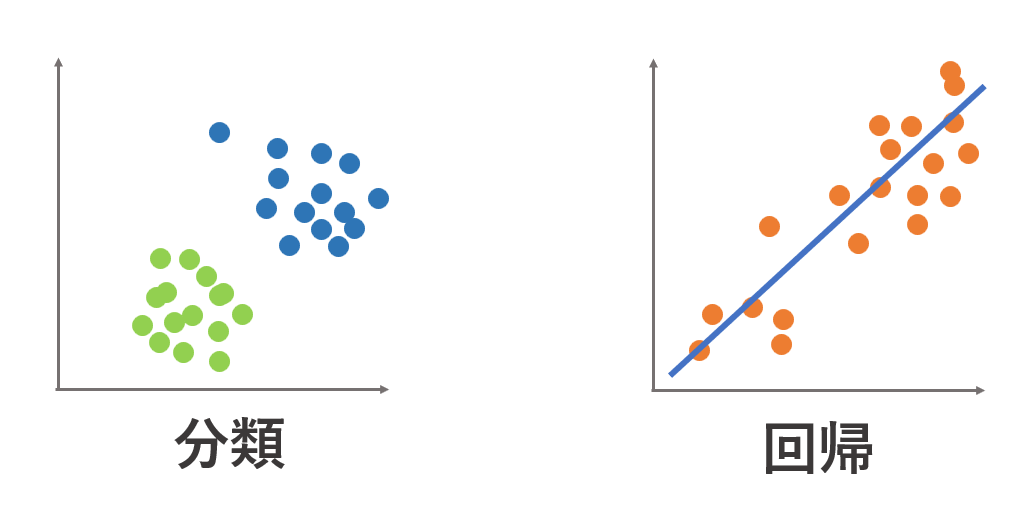

以前も少し解説しましたが回帰と分類の違いを覚えていますか?

回帰:どんな数値になるのかを予測したいとき

分類:これは何なのかを予測したいとき

今回は線形回帰について学んでみましょう!

線形回帰

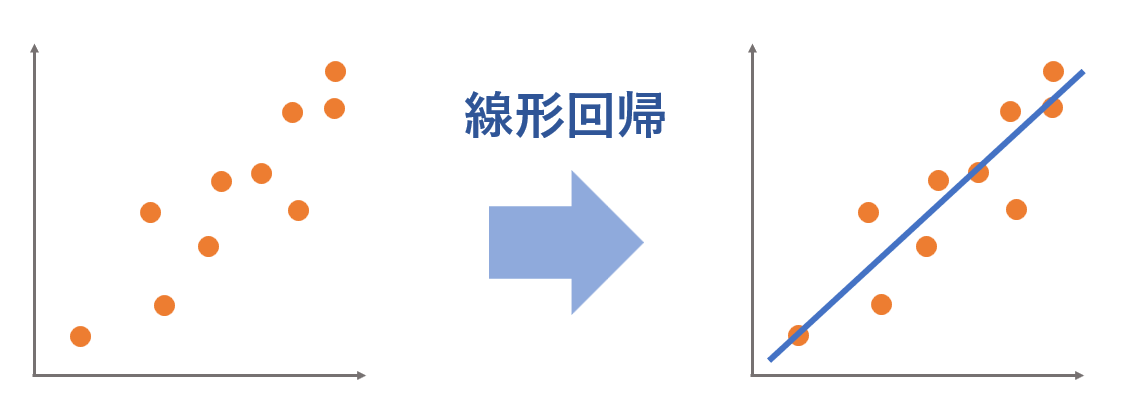

線形回帰とは、散布図の点のばらつきや並び方をみて、線が引けるような法則性が見えるとき「線を引いて予測する」そして、「その線へ戻っていく」という意味をもっています。

現実世界では、様々な影響でデータに誤差が生まれることがあります。この誤差がなければこのような直線の形になるだろうということです!

何かを予測したいときにはデータをグラフにして考える必要があります。そのとき、データを結ぶ「線」を引くことで予測をすることができます!

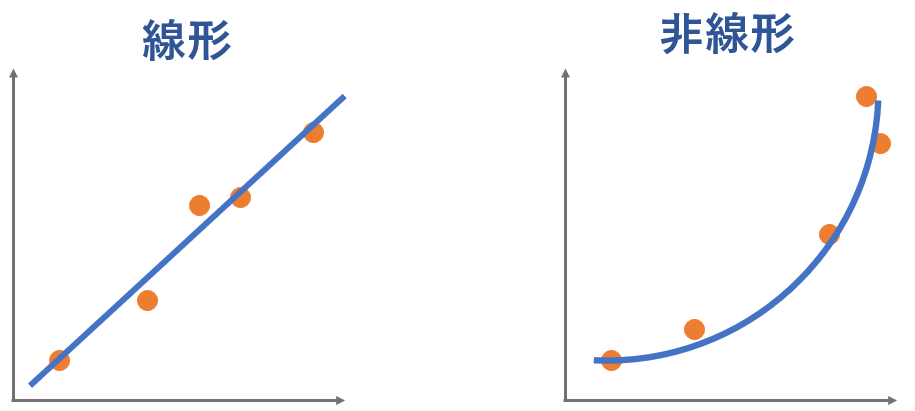

線を引く2つの方法

・まっすぐな線(線形回帰):

データがまっすぐな関係になりそうなときに使います。

・曲がった線(非線形回帰):

データがまっすぐではなく、カーブしているときに使います。

どうやって線を引く?

次にどのようにして線を引けばいいのかについてです。

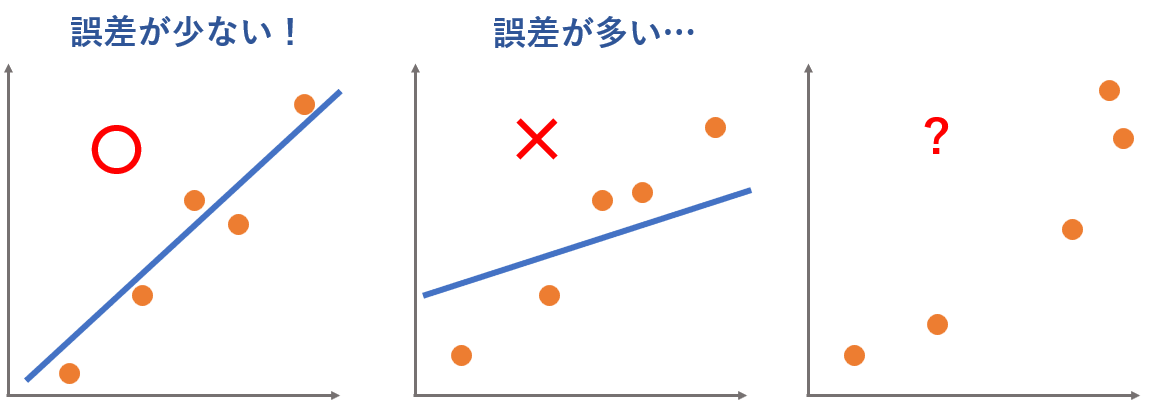

たくさんの点(データ)を一番よく説明できる線を見つけるには、「最小二乗法」という方法を使います。

最小二乗法とは、「データと線のズレ」を一番小さくするように線を引く方法です。ズレが少ないほど、データにぴったり合う線になるのです!

線形回帰は、グラフにするとどんな関係があるかが一目で分かりやすくなります!いろいろな予測に使える便利な方法です!